AI時代、クリエイターが直面する「ハルシネーションによるコンテンツ制作の崩壊」について危機感を感じています。

続きを読む: ハルシネーション汚染のミライで生きる。ディレクターの生き残り方AIが作り出す「汚染」

私たちは今、かつてないほどの技術革新の渦中にいます。

ChatGPTやGemini、Soraといった生成AIの登場は、コンテンツ制作の現場を一変させました。

企画書は数秒で叩き台ができ、イメージボードは瞬時に生成され、リサーチの時間は大幅に短縮されました。

多くのディレクターが、この「魔法」に魅了され、業務効率化の恩恵を受けていることでしょう。

しかし、この蜜月の裏側で、静かに、だが確実に進行している病魔があります。

それが「ハルシネーション(幻覚)」の問題です。

AIがもっともらしく嘘をつく。

この現象は現在、単なる「愛嬌」や「過渡期のバグ」として流してしまいがちですが、

感化できない時代がもうすぐそこまできている。そう思っています。

必ず人間がチェックすればいい、なんて個人の問題ではなく、

未来を自らの手でじわりと締め付けていく。

このハルシネーションという現象は、

近い将来、私たちの制作環境を根底から覆す「ハルシネーション汚染」へと進化し、

コンテンツ制作の在り方、ひいてはディレクターという仕事の難易度を加速度的に高め

結果的に、究極の二択を迫られるのではないか。そう思っています。

この記事は、これから来るかもしれない「最悪の未来」を想定して、書き残したいと思います。

第1章:ハルシネーション汚染は「崖」のようにやってくる

ハルシネーション汚染の根本原因は、AIではなく

人間に起因するのではないかということです。

ハルシネーションそのものは、AIが起こすものですが、

ハルシネーション汚染は人間が起こすものだと思っています。

ハルシネーションがAIの技術的にどのように発生するのか、

その仕組みを分かっているわけではありません。

ですが、チャット型のAIの仕組みや出力される文章から推察するに

統計的に確立の高いものを並べている。

そして、ハルシネーションが起こりにくいように、

検索情報の優位性や重要性についてレーティングやフィルターがけを行い

生成の精度をコントロールしている。そのような挙動を感じます。

現状のAIは、情報の整理や検証が出来ている訳ではなく、

細かい微調整や優位性により精度を高めている。

そういったところではないでしょうか。

すると、結局のところ、

元の情報の確度や精度に依存していることは変わりません。

間違った情報が多ければ、出力されるAIの情報もブレていくわけです。

その情報を発信するのは、結局のところ人間に依存しているわけで。

AIの精度がどれほど高いものになっても、

この根本のソースの精度からは逃れることができない事実だということです。

1-1. 事実の「突然の崩壊」

ChatGPT率いるOpenAIやGeminiを開発するグーグル。

巨額の投資を行い開発を行っているのだから

多くの人は、AIによるハルシネーションの混乱は、徐々に収まっていくと考えているはずです。

しかし、私の予測は異なります。

先程述べた通り、どれほどハルシネーションを発生する挙動を抑えることが出来ても

元の情報が間違っているのであれば、現実的にはハルシネーションを止めることはできないと考えているからです。

そして、ハルシネーション汚染は、世代の移り変わりによって突然、

津波のようにやってくるのではないかと予想しています。

1-2. 中間層の消失と「AIネイティブ」の台頭

想像してみてください。

検索エンジンや実際の現場や当事者に裏取りをするのが当たり前だった世代が現場を退き、

代わりに「AIに聞くのが当たり前」の世代が社会の中核を担う時代になったときのことを。

彼らは、生まれた時からAIが生活の一部であり、

AIが提示する回答を「ベースの知識」として学習して育ちます。

私たち今の世代が、図書館の百科事典よりもGoogle検索を信じるようになったのと同様、

あるいはそれ以上に、彼らはAIに対して盲目的になっている可能性があります。

またこの時代になると、事実検証がより難しくなると予想しています。

ここで恐ろしいのが、「検証する術(すべ)」を持たない世代の時代の到来です。

従来であれば、様々なコンテンツは先輩ディレクターが「その情報のソースに当たったか?」と指導や確認を行い、

情報の真偽をある程度見極める、チェックフローが存在していました。

しかし、AIによる業務効率化は、

皮肉にもこの「育成と継承の中間層」をごっそりと削ぎ落としてしまいます。

検証や確認のノウハウを持たないまま、AIの回答を絶対視する世代の人たち。

確かにAIの出力する情報の精度は非常に高く、先輩ディレクターが間違っているこの方が多いでしょう。

しかしAIの回答には、むらっ気があることは事実です。

強い面と弱い面があります。

最新情報やゴシップ、流行といった情報の視点が移ろいやすく確証性の薄いものは、

これれか先もAIの精度は低いものになっているはずです。

しかし、コンテンツには鮮度が求められます。

情報の速さが求められる点についてはこれから先も変わらないでしょう。

するとどうなるか。

精度が出せない中、出力したAIの情報を元にコンテンツが量産されるされてくるはずです。

量産されたコンテンツは僅かな間違い内包したまま、それがまたAIの情報源となります。

このような状況が様々な業界で同時に階層的に作られていく未来を想像しました。

この僅かにハルシネーションが含まれるコンテンツが癌のようにジワジワと効いてくるのではないか。

その頃には、情報の検証をする術もなく、ノウハウも失ってしまった場合、人間はAIの情報を疑いはするも、

受け入れるしかなくなる時代がやってくるのではないかと予想しています。

1-3. 妥協と諦めが支配する世界

また現実的にハルシネーション汚染を加速させる要因として、

検証するコストが、制作コストを上回り、現実的な着地点として「諦め」が要求されることです。

競争が激化する中で、右も左も効率化が求められ、

シンプルに妥協しなければ成立しなくなるのではないか。

「AIが言っているのだから、多分合っているだろう」「ここまで情報が整っているのだから、多少間違っていても仕方がない」

そうした心理的バイアスや納期や競合との争いで疲弊し、盲目的にAIの言葉を採用するようになります。

そうして世に放たれた「ハルシネーションを含んだコンテンツ」が、

再びWeb上を巡り、次のAIの学習データとなる。

これが「ハルシネーション汚染」の正体なのです。

第2章:汚染は「ディレクター」が作り出す不都合な真実

問題は、AIではなく人間の方にあります。

2-1. AIのせいにするのは簡単だが

この汚染を生み出し、加速させるは、他ならぬ私たちディレクター自身です。

そして、その汚染によって将来もっとも苦しむことになるのも、またディレクターなのです。

2-2. AIの仕組みと「80対20」の落とし穴

AIは基本的に、過去の論文、動画、Webサイトなどの膨大な情報を学習し、

確率的に「もっともらしい答え」を生成するシステムです。

もちろん、論文や公式サイト、ファクトチェック済みの情報を優先するようなアルゴリズムは組まれています。

しかし、Web上には「間違った情報」も無数に存在します。

かつては正しかった情報も研究が進み覆った情報、

アクセス稼ぎのために誇張された情報、そして単純な誤植。

AIは情報の信頼性を評価する際、アクセス数や引用数も指標にするため、

「間違っているが、広く拡散されている情報」を「正」として学習してしまうリスクも常に孕んでいます。

ディレクターは、特定の分野にある程度詳しいとはいえ、専門の研究者ではありません。

情報の精度を100%担保する能力は持ち合わせていないものです。

また情報はより複雑さを増し、横断的な整合性が求められるようになってきています。

すると人間の一人の知識だけでは判断できない時代へとなっていくことでしょう。

すると、よりAIへの依存が高まっていくことが予想されます。

効率化のために人を減らし、一人が判断、処理する量は指数関数的に増えていく。

作業時代のベースはAIに頼らざる無くなり、

全体の80%の作業をAIが行い残りの20%を人間が処理するようになる。

残り20%の業務と言っても担う業務の全ては、重要な決定と判断になります。

すると結果的に今よりも余裕のない仕事感になることは間違いありません。

こうなると、一つのコンテンツの整合性をチェックスすること自体が当人の膨大なコストを消費することになり、

検証の難易度をより高めてしまう。

この仕組みの連鎖が、そこら中で発生し、積み重なることで、

ソースを探ってもソースの精度すら検証できなくなっていくのではないかと予想しています。

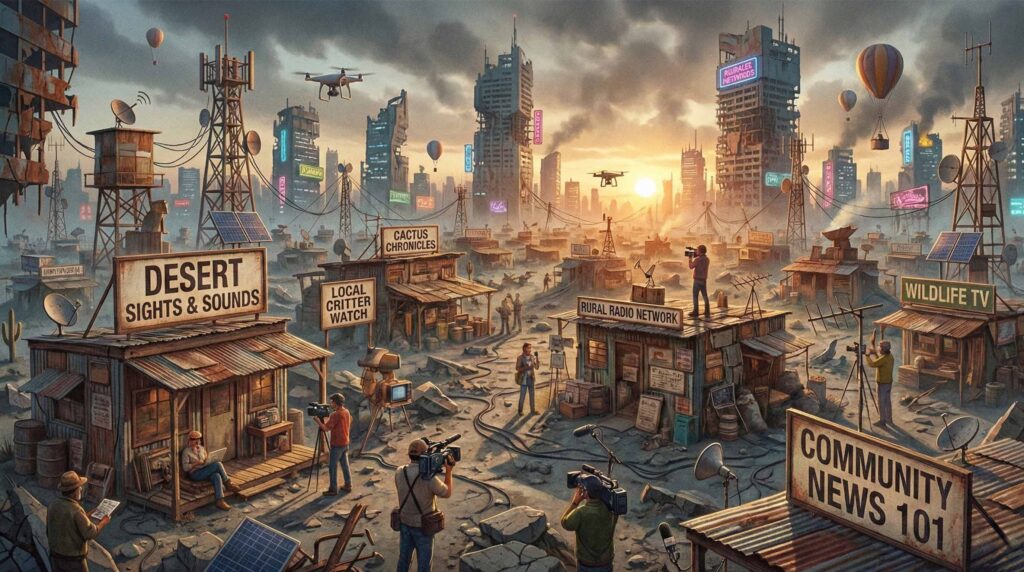

2-3. 小さなメディアの台頭と無限の悪循環(モデル崩壊)

問題はここからです。

これらのコンテンツが量産され、小さなメディアが小さな成功し、

乱立する時代が来るでしょう。

そうなると、これらのコンテンツもある一定の権威性や確証を獲得することになるはずです。

AIは格上げされたことでこれらのコンテンツの質を正しいと判断するようになり、

情報の確度が自然と濁っていく。

小さなメディアが乱立することで、

複数の視点でのコンテンツが作られAIの精度判定がより揺らぎやすくなるでしょう。

ソース自体を検証しようにもその先には、AIがほとんど作ったものです。

検証の限界がやってきて、正しいものがなんなのか分からなくなっていく。

そしてディレクター含め、判断できる人間が誰もいなくなってしまう。

そんな時代がやってくるのではないでしょうか。

この悪循環(負のループ)により、世の中の情報空間全体が汚染されていく、

人間が「正しい情報」と「間違った情報」の区別すらつかなくなる未来。

これこそが、私が恐れる「ハルシネーション汚染」の世界です。

第3章:次世代のボトルネックは「現場」と「真実」

負のループは競争と効率化によって、避けられないものになるのではないでしょうか。

3-1. 制作フローの激変

ハルシネーション汚染が蔓延する未来において、

ボトルネックとなるのが現場との折り合いです。

ですがこのボトルネックこそが生き残る鍵かもしれません。

多くの作業をAIが肩代わりするとは言え、判断するのは人間です。

その結果、コンテンツ制作におけるボトルネック(最も手間とコストがかかる部分)は、

以下の2点に集約されていくと予想します。

- 「現場」での物理的対応

- AI生成情報に対する「ファクトチェック」

3-2. 解決できない「現場」、重くなる「チェック」

1つ目の「現場対応」は想像に難くありません。

AIはいまだ身体性を持ちません。

情報を収集するにしても大事な情報へのファーストコンタクトは人間が行うべきでしょう。

信頼関係がなければよりよい情報は得られません。

また、情報を得るための関係値作りによりコストが割かれるようになるでしょう。

また取材対象者の本音を引き出すコミュニケーションや下地作り。

これらはAIが介入できない、最も人間的でコストがかかる聖域として残ります。

これは現在の延長線上にあり、大きな混乱はないでしょう。

真に深刻な問題となるのが、2つ目の「ファクトチェックにかける工数」です。

AIが瞬時に吐き出したもっともらしい情報やソース有りの情報であっても、その情報が汚染されたデータであるならどうでしょうか?

その検証プロセスやディレクターのスキルをどのように育成していくかが課題になるでしょう。

問題となるのがスキルの醸成です。

スキルの醸成をするには、結局のところ業務経験が必要です。

この業務経験は、実務としての経験と取材先となる業界の知識のどちらも必要となります。

この経験が深く、最新の知見にも視野が開けているからこそ、今は、AIが出力された情報にも

ハルシネーションが含まれていることへの違和感にいち早く気がつけるのです。

しかしAIが当たり前になった世代は、

ハルシネーションに対しての嗅覚が育たず問題を特定できない世代になるのではと思っています。

そんな世代に、スキルを醸成させるのが、そもそもの大きな壁になるのではと予想しています。

きっと彼らなら「非効率」「ブラックな作業」「自らの経験や視野を狭める」なんて、

思ってしまうのではないでしょうか。

そしてAIのハルシネーションがあることを疑うことこそが、

古臭く、危険な思想と排他的な認識となってしまい、スキルが醸成できない世界。

一部の上昇志向の人だけが希望制で学ぶ領域になってしまうのではないかと感じています。

ファクトチェックの行為が「悪」と論じられる時代になってしまうと、

ファクトチェックをさせることが難しくなってしまい、

結果的に膨大なコストを支払うはめになり、小さなメディアが今度は淘汰され始める。

そういった未来になってしまうのでしょうか。

第4章:未来のディレクター、3つの生存戦略

では、このような未来で私たちディレクターはどう生き残ればいいのでしょうか?

現実的にディレクター個人ができることは多くないと予想しています。

具体的な対策としては、未来がどのように動くかを予想しつつ、

少し早く時代の波に乗り、自身またはメディアの信頼を失う前に

シフトするしかないのではないでしょうか。

具体的な予想される未来について紹介したいと思います。

【世界線1】研究者の「囲い込み」と新たなプラットフォーマーの登場

研究者の囲い込みをが行われるでしょう。

AIの信頼性やファクトチェックには今後、より専門性の高い人の認証が必須になってくると予想されます。

そこで、さまざまなメディアなどは研究者の囲い込みが行われることが予想されます。

ですので、私自身も研修者へのコネクション作りが重要になってくると予想します。

今後、学術的な専門家、研究者の地位の人は飛躍的に市場価値が向上すると予想しています。

AIが生成する情報の信頼性が揺らぐ中、情報の担保はすべて彼らのような「生身の専門家」の見解に委ねられるからです。

「研究者のファクトチェックなしでは、コンテンツの公開が許されない」 そんな時代が来るかもしれません。

これからのコンテンツ制作会社やメディアは、研究者や研究機関と直接契約を結ぶか、

あるいは社内に専門の研究部門(大企業が持っているような研究部門のようにメディアも自社で研究者を社員として迎え入れたり、

研究部門を設立したり)を抱える組織体へと変化が求められるのではないかと思っています。

あるいは、信頼できる研究者とメディアをつなぐ「高度専門知のファクトチェックのためのマッチングサービス」

Netflixのようなプラットフォームが登場し、アクセス権をサブスクリプションとして提供される時代が来るのではないでしょうか。

間口が開かれれば、平均的な価格帯のサブスクリプションになるかもしれませんが、

独占的なプラットフォームになった場合、

資金力のある大手メディアやオウンドメディアしか利用できないサービスになる可能性も考えられます。

情報の精度による格差で、バリューを作り出すメディアが生まれてくるかもしれません。

ディレクター個人としては、横の繋がりや、そういった研究者へのコネクション作りが重要になるでしょう。

また、自身が業界の特定の領域や業種への専門性を持つ事も生き残る術になるでしょう。

【世界線2】相互補修型のプラットフォームへの移行(「大衆の知恵」の実装)

情報は日々変化し、視点による見え方も様々です。

コンテンツ一つ一つに、2ch、4chのようなスレッドのような仕組みが実装され、

コンテンツの情報がリアルタイムに訂正され続けるプラットフォームが標準となる未来です。

現在、X(旧Twitter)に実装されている「コミュニティノート」のような機能や、

WIKIpediaのような仕組みが分かり易いかもしれません。

これが動画やWEB媒体においても実装され、第三者が常に情報を訂正し、

精度と鮮度を保つような自浄作用で回していく世界の未来です。

動画、記事、画像、あらゆるコンテンツに対して機能が実装され、

コンテンツの中でも特定のものを指定でき、一部を訂正や補足が行える。

コメントや修正履歴は、横断的にAIが判断をして、信頼性や権威性を判定しつつ、

あらゆるコンテンツが一定以上の精度を持つような社会になるのではないか。

AIやディレクターが見逃したハルシネーションも、世界中のユーザー「大衆の知恵(集合知)」により、

補正されるようなシステムが標準化されるのではないか。

Wikipediaがそうであるように、相互監視と相互修正によって、情報の精度を担保するエコシステムです。

この世界線では、ディレクターは「完璧な真実」を作ることよりも、

公開後に修正されることを前提とした長期保守も含めた価値の有無の見極めや、

長期でみたときの有益性、コンテンツの質の見極めが求められそうです。

【世界線3】個人一人一人が専門領域化した世界

上記の二つのどちらも実装されなければ、一人一人が専門領域に特化した世界になることが予想されます。

大きなメディアや媒体であってもコンテンツ単体、

またはコンテンツ内のワンセクションの制作の外注が行われる形式になる世界線です。

発注者がテーマやコンテンツごとにそれぞれの専門家を招集し、その一人として参画する世界です。

ここでは、専門性がない人は淘汰され、生き残ることはできません。

記事であれば数行や十数行のために、参画することもあるでしょう。

動画コンテンツであっても十数秒の尺の一部を専門家として監修したりディレクションを行う形の働き方になるでしょう。

薄利多売ですが、専門領域の一部だけを担うので労力は掛かりませんが、精度とスピードがものをいう社会になるかもしれません。

例えば、ラーメン評論家のような位置づけの人がひしめき合う状況がイメージしやすいかもしれません。

研究者である必要はありません。

ですが、ファクトチェックに対応できる力、そのテーマに対して文脈を把握し、OKとNGが出せる力が求められるでしょう。

このような未来を生き残るために、 どのような未来が来ても対応できる対策としては、

ディレクターでありながら、その領域領域を持つことだと感じています。

結局、最後のGOサインを出すのは人です。

その判断をするためにはその領域について知っている必要があります。

どれほどAIに精通してもスピードが速くなるだけで、「完成」させることができないからです。

どんなハルシネーションもハルシネーションを嗅ぎ分ける業界知識や感が求められます。

「微妙なニュアンス」を判断できる審美眼は、経験の深さからしか生まれないのです。

医療、歴史、宇宙工学、サブカルチャー、法律、料理。

どのようなジャンルであれ、自身の知識を研究者レベルに近づけ、「半分はその業界の人間」として振る舞えるようになること。

自身の脳内に強固なデータベースとロジック、業界監修や文脈に理解を持ち、AIが出してきたアウトプットに対して、

「なにか怪しい」と勘づく能力。

結局のところ、自身の知識と判断能力を高めることが、

ハルシネーション汚染に対する最強の防衛策であり、生き残る術になるのではないかと予想しています。

これからのディレクターの価値は、「どれだけ正確に判断できるか」かが鍵なのではないでしょうか。

まとめ:ハルシネーション汚染された世界で生きるには

これからの時代、おそらく線領域に特化していくことと、

専門領域へのコネクションやアクセスを持つことが重要になってくるでしょう。

繰り返しになりますが、ハルシネーション汚染は、突然やってきて状況を混乱に落とし込むはずです。

「まだ大丈夫」と思っている間に、AIネイティブ世代が社会に溢れ、

中間層が消え、ある日突然、情報の信頼性が崩壊する「崖」がやってきます。

それは、これまでの常識が通用しない津波のようなパラダイムシフトのような感覚に襲われるかもしれません。

ですが、未来の形が予測できているのであれば、準備ができます。

AIという荒波を乗りこなすためのサーフボードは、AIを使う技術ではありません。

泥臭く足や手で稼いだ経験からくる勘といったものが、再評価される時代になっていくことでしょう。

AIが提示する世界を疑い、検証し、真実を担保するのは最終的には人間なのですから。

この記事が、来るべき混沌の時代を生き抜くための小さなコンパスとなれば幸いです。